Microsoft, Google ir xAI atidavė savo modelius vyriausybei. NIST patikrins prieš išleidimą.

·

Antradienį, gegužės 5 dieną, JAV Komercijos departamento padalinys CAISI paskelbė trumpą, bet svarbų sandorį. Microsoft, Google ir xAI sutiko atiduoti savo dar neišleistus DI modelius vyriausybės testavimui. Anksčiau. Prieš tai, kai juos pamatytų pasaulis.

Tai naujas etapas. Iki šiol panašius susitarimus turėjo tik OpenAI ir Anthropic — dar nuo 2024 metų, Bideno laikų. Dabar trys didieji prisijungia. Ir tai jau ne savanoriška iniciatyva, o reali pramonės norma.

Kas yra CAISI ir kodėl jis ėmė ką nors testuoti

CAISI — Center for AI Standards and Innovation. Veikia po NIST stogu, kuris yra Komercijos departamento dalis. Iš pažiūros nuobodi vyriausybinė kontora. Bet per pastaruosius metus jie atliko per 40 DI modelių vertinimų. Tai nemažai. Ir tai paaiškina, kodėl įmonės pradeda kreipti dėmesį.

CAISI direktorius Chris Fall apibūdino sandorį paprastai: „Nepriklausomas, griežtas matavimo mokslas yra būtinas, kad suprastume pažangiausių DI modelių poveikį nacionaliniam saugumui.” Vertimas iš biurokratinės — vyriausybė nori pamatyti, ką šie modeliai daro, prieš tai, kai juos paleidžia į rinką.

Įdomiausia, kad sandoris yra savanoriškas. Tai ne įstatymas. Įmonės pačios sutiko. Tai svarbu, nes parodo, kad jos jau supranta — be vyriausybės testavimo modelius išleisti šiandien yra rizika. Ne saugumo prasme, o reputacijos.

Kodėl būtent dabar — Mythos efektas

Pasakymas „spaudimas tapo per didelis” čia tinka. Balandį Anthropic išleido naują modelį pavadinimu Mythos. Jis sukėlė rimtų klausimų. Bankai, energetikos kompanijos ir vyriausybės pradėjo bijoti, kad pažangiausi DI modeliai gali tapti kibernetinių atakų įrankiu. Ne teoriškai. Praktiškai.

Po to Baltieji Rūmai pradėjo svarstyti formalų DI peržiūros procesą. Spaudimas išėjo iš „norėtume” zonos ir įžengė į „verčiau sutikti dabar, nes vėliau bus blogiau”. Microsoft, Google ir xAI sumetė matematiką ir parašė savo pavadinimus.

Tuo pačiu metu Anthropic atsidūrė kitoje pusėje. Pentagono kontraktą jis prarado, nes nesutiko su tam tikromis sąlygomis. Tame pačiame laikotarpyje. Ironiška, kad tas pats Anthropic prieš dvejus metus buvo tarp pirmųjų, kurie sutiko su CAISI testavimu.

Ką tai keičia įmonėms ir tau

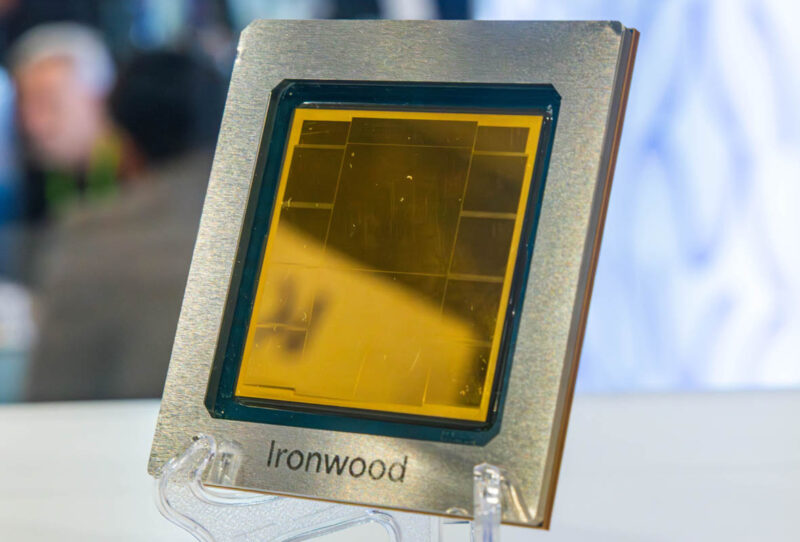

Pradžiai — atsiranda nauja kategorija „pre-launch testing”. Tai reiškia, kad Microsoft Copilot Next, Google Gemini 4 ar xAI Grok 5 (ar kaip jie ten vadinsis) prieš pasirodydami komerciniame produkte, pirma keliaus į NIST. Ten juos vertins saugumo specialistai. Žiūrės, ar modelis nesumokytas pasakyti, kaip pasigaminti biologinį ginklą. Ar nesugeba apeiti banko apsaugos sistemų. Tokie dalykai.

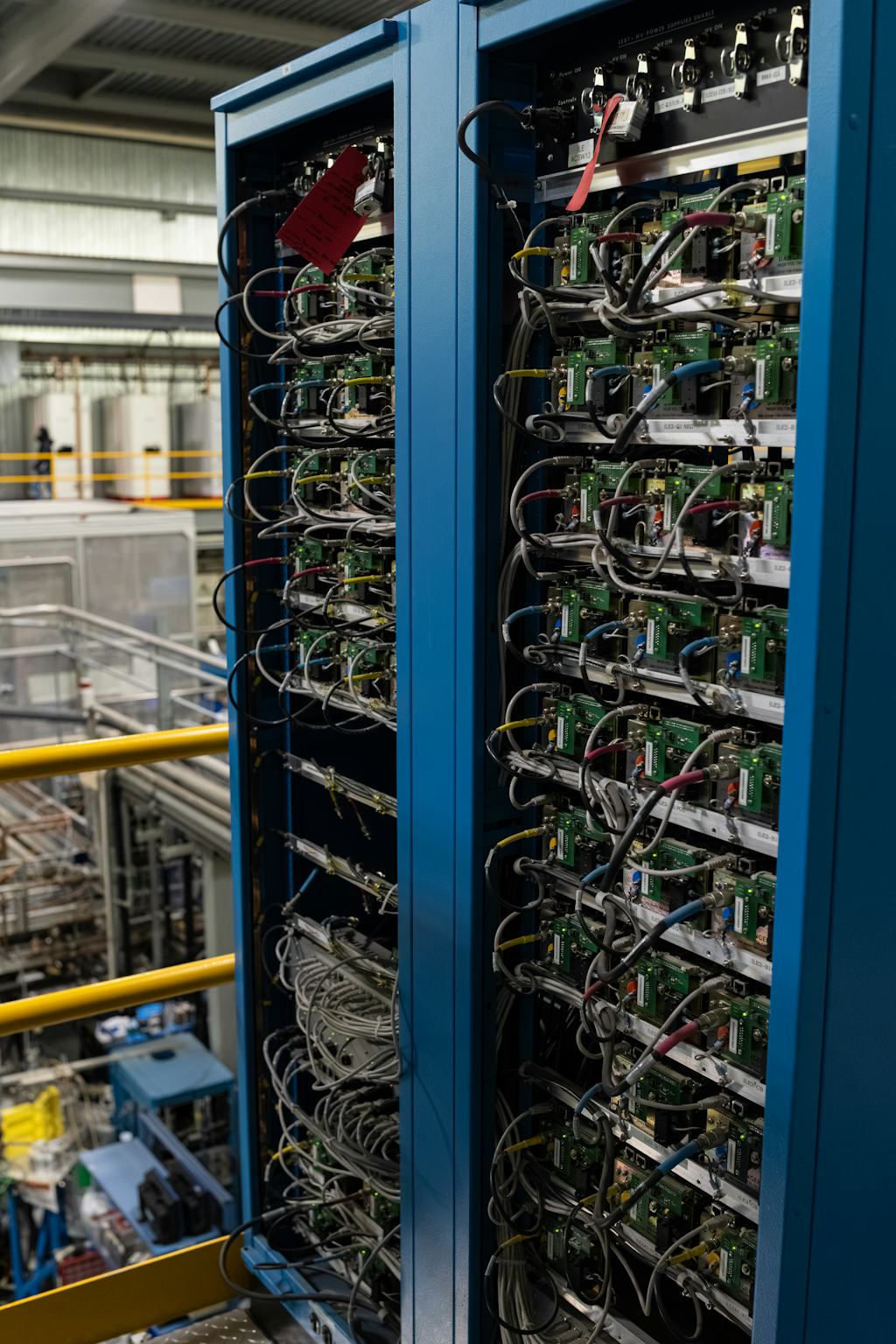

Yra ir kitas aspektas — resursai. Georgetown universiteto tyrėja Jessica Ji pastebėjo, kad CAISI tiesiog neturi tiek pat žmonių ar skaičiavimo galios kiek didieji. „Jie tiesiog neturi tokių resursų — nei darbuotojų, nei techninio personalo, nei prieigos prie compute.” Tai logiška. Vyriausybė bando testuoti milžinišką biudžetą turinčias įmones su valstybinio sektoriaus algomis.

Bet tai vis tiek geriau nei nieko. Ir tai keičia žaidimą — anksčiau modeliai keliaudavo tiesiai į rinką. Dabar yra filtras.

Kodėl tai svarbu Lietuvoje

Kažkas pasakys — kam mums rūpi, ką testuoja amerikiečių vyriausybė. Bet realybėje šie modeliai veikia ir Lietuvoje. Microsoft Copilot naudoja Lietuvos verslai, savivaldybės, kai kurios ministerijos. Google Gemini sėdi telefone. xAI yra Elono Muską mėgstančių techninių žmonių žaislas, bet ir jis plečiasi.

Jei amerikiečiai randa, kad modelis turi rimtų saugumo skylių, tai veikia visus. Jei jie pataisymą reikalauja prieš išleidimą — gauname saugesnį produktą ir mes. Be to, ES rengia savo AI Act įgyvendinimą, ir CAISI darbas duoda informacijos, kuria gali pasinaudoti Briuselis.

Lietuvos kibernetinio saugumo specialistai jau seniai stebi, kaip deepfake atakos pasiekia bankus ir vyriausybines institucijas. CAISI testavimas — dar vienas barjeras tarp tokio modelio ir kasdienybės.

Tikras klausimas — ar to užtenka

Atsakymas, deja, ne. CAISI testuoja modelį, bet ne tai, ką su juo daro vartotojai. Ne tai, kaip jis integruotas į produktą. Ne tai, kaip jis elgiasi po fine-tuning’o. Tai tik vienas pjūvis.

Antra, savanoriškumas reiškia, kad bet kada vienas iš trijų gali atsisakyti. Jei Microsoft kitais metais nuspręs, kad CAISI testavimas užima per ilgai, sandoris baigsis vienu el. laišku. Tas pats su Google. Tas pats su xAI.

Trečia — Kinija. Visa ši infrastruktūra netaikoma DeepSeek, Qwen ar kitiems Kinijos modeliams, kuriuos Lietuvoje irgi naudoja. Mąstančio režimo DI ten kuriasi sava trajektorija ir niekas iš JAV CAISI ten nepatikrins.

Ir vis dėlto. Tai yra žingsnis, kuris vyksta dabar, ne 2030 metais. Tai svarbu. Penki metai atgal niekas nebūtų tikėjęs, kad Microsoft savanoriškai atiduos modelį Komercijos departamentui prieš išleidimą.

Ką tau daryti su šia žinia

Jei dirbi su DI įrankiais kasdien — pasižymėk, kad ateityje gausi modelius, kurie buvo patikrinti ne tik įmonės viduje. Tai gali reikšti šiek tiek vėlesnius išleidimus, bet ramesnius miegus.

Jei valdai komandą — pradėk galvoti apie savo vidines politikas, kaip reaguoti, jei CAISI testavimas atskleis problemų jau po išleidimo. Mythos atvejis parodė, kad reakcija turi būti per kelias valandas, ne dienas.

O jei stebi šį visą lauką iš šono — gera žinia. Reguliacija ateina nebe per 200 milijardų dolerių sandorius, o per techninį testavimą. Ir tai reiškia, kad pati DI pramonė pripažįsta — be priežiūros nebėra ir nebus.

Klausimas tau: kuriuo modeliu pasitikėtum labiau — tuo, kuris testuotas vyriausybės, ar tuo, kuris išėjo per naktį be kontrolės?