Kas yra TPU ir kuo skiriasi nuo GPU. Paaiškinta paprastai 2026 metais.

·

Skaitai apie DI lustus ir matai dvi santrumpas. GPU ir TPU. Abu skirti DI darbui. Bet skirtumas yra didelis, ir 2026 metais jis tampa labai svarbus tavo pinigams.

Šiame straipsnyje paaiškinsiu paprastai. Be techninio žargono. Tikslas, kad supratus skirtumą, suprastum, kodėl Anthropic žada Google 200 milijardų dolerių už TPU lustus ir kodėl tai keičia visą DI rinką.

Pradžia. Kas yra GPU

GPU reiškia Graphics Processing Unit. Originaliai šie lustai buvo skirti vaizdo žaidimams. NVIDIA, AMD ir kitos kompanijos juos darė tam, kad žaidimai geriau atrodytų.

Pati esmė yra paralelinis darbas. GPU sugeba vienu metu atlikti tūkstančius mažų skaičiavimų. Žaidimuose tai reiškia tūkstančius pikselių, kurie skaičiuojami tuo pačiu metu. DI atveju tai reiškia tūkstančius matricos veiksmų vienu metu.

Maždaug 2012 metais mokslininkai pastebėjo, kad GPU puikiai tinka neuroniniams tinklams. Nuo to laiko NVIDIA tapo viena vertingiausių pasaulio įmonių. Visa moderni DI revoliucija prasidėjo nuo žaidimų lustų.

Antra dalis. Kas yra TPU

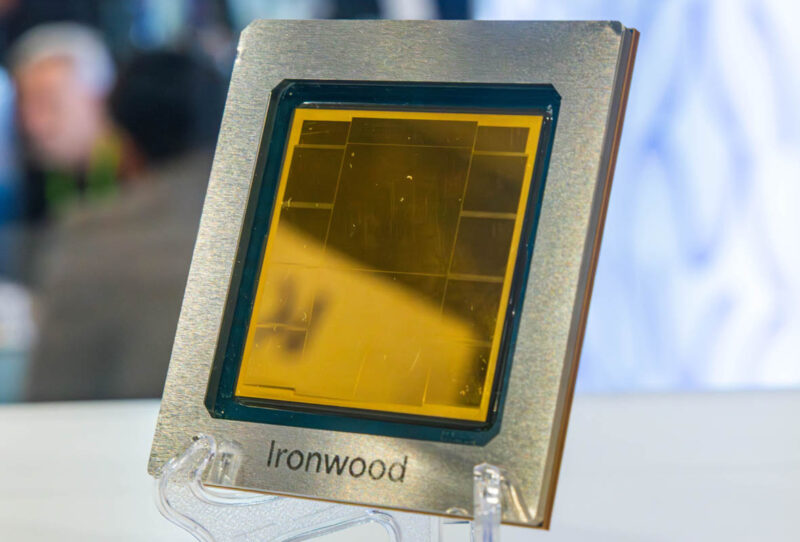

TPU reiškia Tensor Processing Unit. Šiuos lustus kuria Google. Pirmoji TPU karta buvo paleista 2015 metais, ir nuo tada Google sukūrė aštuonias kartas.

Skirtumas nuo GPU yra esminis. TPU buvo suprojektuoti nuo nulio specialiai DI darbui. Ne žaidimams. Ne grafikai. Tik mašininio mokymo skaičiavimams.

Tensor lietuvių kalboje galima versti kaip tenzorius. Tai matematinis objektas, kuris yra skaičių rinkinys daugiamatėje erdvėje. Visi šiuolaikiniai DI modeliai dirba būtent su tenzoriais. TPU tam yra optimizuotas, kaip Formulės 1 automobilis lenktynių trasai.

Pagrindiniai skirtumai

Specializacija. GPU yra universalus įrankis. Jis tinka grafikai, video apdorojimui, mokslo skaičiavimams ir DI. TPU yra tik DI. Bandymas paleisti žaidimą ant TPU būtų panašus į bandymą važiuoti Formulės 1 mašina į parduotuvę.

Energijos efektyvumas. Naujausios kartos TPU yra žymiai efektyvesni už palyginamo lygio GPU. Mažiau elektros, daugiau skaičiavimų. Kai duomenų centrai susiduria su elektros krize, šis skirtumas tampa kritinis.

Prieinamumas. NVIDIA GPU gali nusipirkti bet kuri įmonė ar privatus asmuo. TPU galima naudoti tik per Google Cloud. Negausi TPU lusto į savo kompiuterį net jeigu turėtum milijoną eurų.

Kaina. TPU yra pigesni už lygiavertį GPU pajėgumą. Bet tu moki Google už nuomą, ne perki. Per ilgą laikotarpį tai gali būti ir pranašumas, ir trūkumas, priklausomai nuo to, kiek planuoji naudoti.

Praktinis pavyzdys

Įsivaizduok, kad nori apmokyti didelį DI modelį, panašų į GPT-4 ar Claude. Tau reikia milžiniškos skaičiavimo galios, kuri vienu metu paleidžia milijardus matricos operacijų.

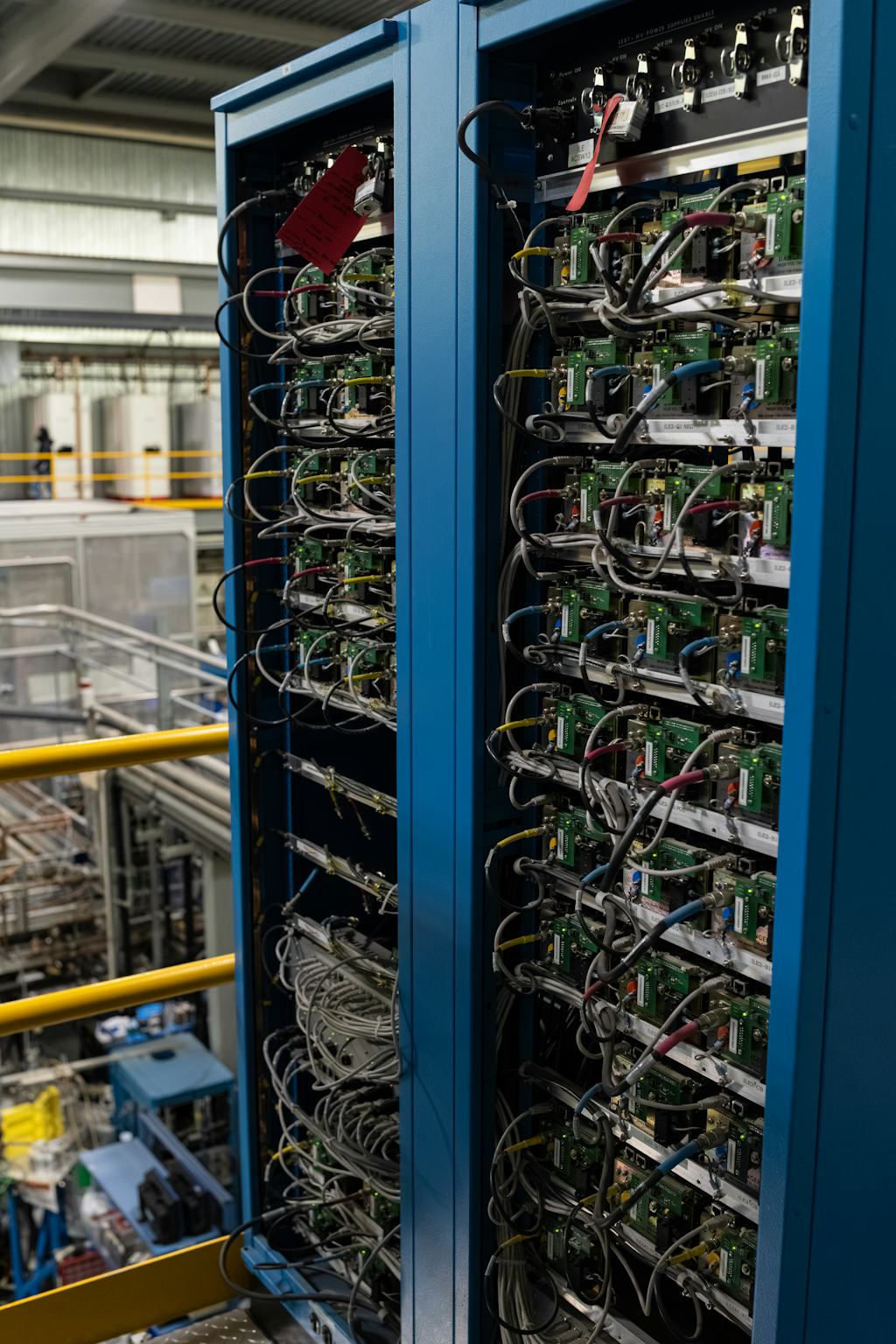

Variantas A. Perkam tūkstančius NVIDIA H100 GPU. Sumokam apie 30 000 dolerių už vienetą. Statome savo duomenų centrą. Mokame elektrą, samdome žmones, prižiūrime. Universalus sprendimas, bet brangus ir lėtas startuoti.

Variantas B. Nuomojame TPU iš Google. Mokame valandinę kainą, kuri pradeda nuo kelių dolerių už lustą. Dirbame Google Cloud aplinkoje. Greitas startas, bet priklausomybė nuo vieno tiekėjo.

Variantas C. Mišinys. Naudojame ir GPU, ir TPU, ir kitus lustus. Tai daro Anthropic, kurio strategija apima Google TPU, Amazon Trainium ir NVIDIA GPU. Anksčiau rašėme, kaip Anthropic net ieško alternatyvos NVIDIA britų startuolyje.

Kuris geresnis

Nėra paprasto atsakymo. Priklauso nuo to, ką darai.

Jeigu kuri lankstesnį DI darbą su skirtingomis užduotimis, GPU yra geresnis pasirinkimas. Jeigu darai didelio masto modelio mokymą ar inference, TPU dažnai išeina pigiau ir greičiau.

Google pati naudoja TPU savo Gemini modeliams. Anthropic naudoja viską, kas yra. OpenAI iki šiol stipriai rėmėsi NVIDIA, bet pradeda diversifikuotis. Meta pati pradėjo gaminti savo lustus, kad nepriklausytų nuo nieko.

Kodėl tai svarbu tau

Tu greičiausiai niekada tiesiogiai nedirbsi su TPU ar GPU. Bet tavo DI patirtis priklauso nuo to, kokie lustai dirba foną.

Kai siunti žinutę ChatGPT ir gauni atsakymą per dvi sekundes, tai yra GPU darbas (OpenAI infrastruktūra). Kai naudoji Gemini ar Google AI Studio, tave aptarnauja TPU. Kai dirbi su Claude, tikriausiai mišri infrastruktūra.

Kainos, greitis, pajėgumai. Visa tai priklauso nuo to, kuris lustas atlieka skaičiavimus. DI lustai jau vadinami nauju nafta, ir tai ne perdėjimas.

Kas toliau

2026 metais matome ryškų judesį link specializacijos. Google paleido aštuntos kartos TPU su dviem variantais. Vienas mokymui, kitas inference. Tai paprastai vadinama lustų bifurkacija.

NVIDIA atsako su naujomis architektūromis kaip Vera Rubin. AMD spaudžia į rinką. Cerebras siūlo dar kitokį požiūrį su milžiniškais wafer scale lustais.

Dešimtmetis prieš mus tikriausiai matys lustų rinką, kuri yra panaši į automobilių rinką. Bus daug variantų skirtingoms užduotims. Universalus įrankis taps retas.

Trumpa santrauka

- GPU yra universalus DI lustas, originaliai sukurtas žaidimams. Pavyzdys, NVIDIA H100.

- TPU yra Google specializuotas DI lustas. Negali nusipirkti, tik nuomoti.

- TPU dažnai efektyvesnis didelio masto darbui. GPU lankstesnis ir prieinamesnis.

- Anthropic, OpenAI ir kiti naudoja mišrią strategiją.

- Tavo kasdienė DI patirtis priklauso nuo to, kuris lustas veikia foną.

Tikiuosi, kad dabar TPU ir GPU nebėra paslaptis. Sekantį kartą skaitydamas apie naujas DI lustų lenktynes, žinosi, apie ką iš tiesų kalbama.