Kas yra DI inference ir kodėl tai brangesnė nei pati DI mokymas

·

Šitas terminas pastaruoju metu skamba visur. Inference. Kalbėtume apie pinigus, lustų gamyklas, OpenAI ir Anthropic strategijas. Bet jeigu paklausi 10 atsitiktinių žmonių, ką tai reiškia, gausi 10 skirtingų atsakymų. Daugumai jų atsakymai netikslūs.

DU LYGIAI DI GYVENIME

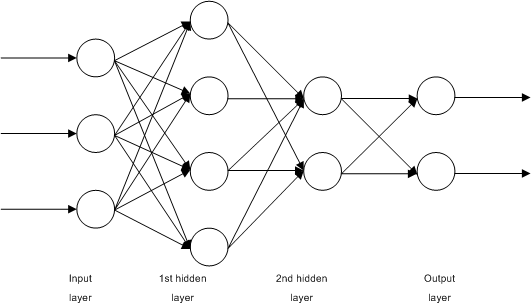

Kiekvienas DI modelis turi du gyvenimo etapus.

Pirmas: training (mokymas). Tai yra tas etapas, kai DI „mokosi”. Pavyzdžiui, GPT-5.5 buvo apmokytas ant trilijonų teksto eilučių. OpenAI per kelis mėnesius leido savo serverius, kad jie sutvarkytų visą šitą informaciją. Tai brangu, bet vyksta tik vieną kartą.

Antras: inference (paleidimas). Tai yra tas etapas, kai tu rašai klausimą ChatGPT’ui ir gauni atsakymą. Modelis jau apmokytas, jis tik „paleidžia” save kiekvienai užklausai. Atrodo paprasta, bet vyksta milijardus kartų per dieną.

KODĖL INFERENCE BRANGIAI

Pirmas atsakymas iš logikos. Jeigu inference vyksta milijardus kartų per dieną, o training tik vieną kartą per metus, akivaizdu, kad pirmasis brangesnis. Tikslesni skaičiai. Inference šiandien sudaro apie 80 procentų visų DI infrastruktūros kaštų. Training tik 20.

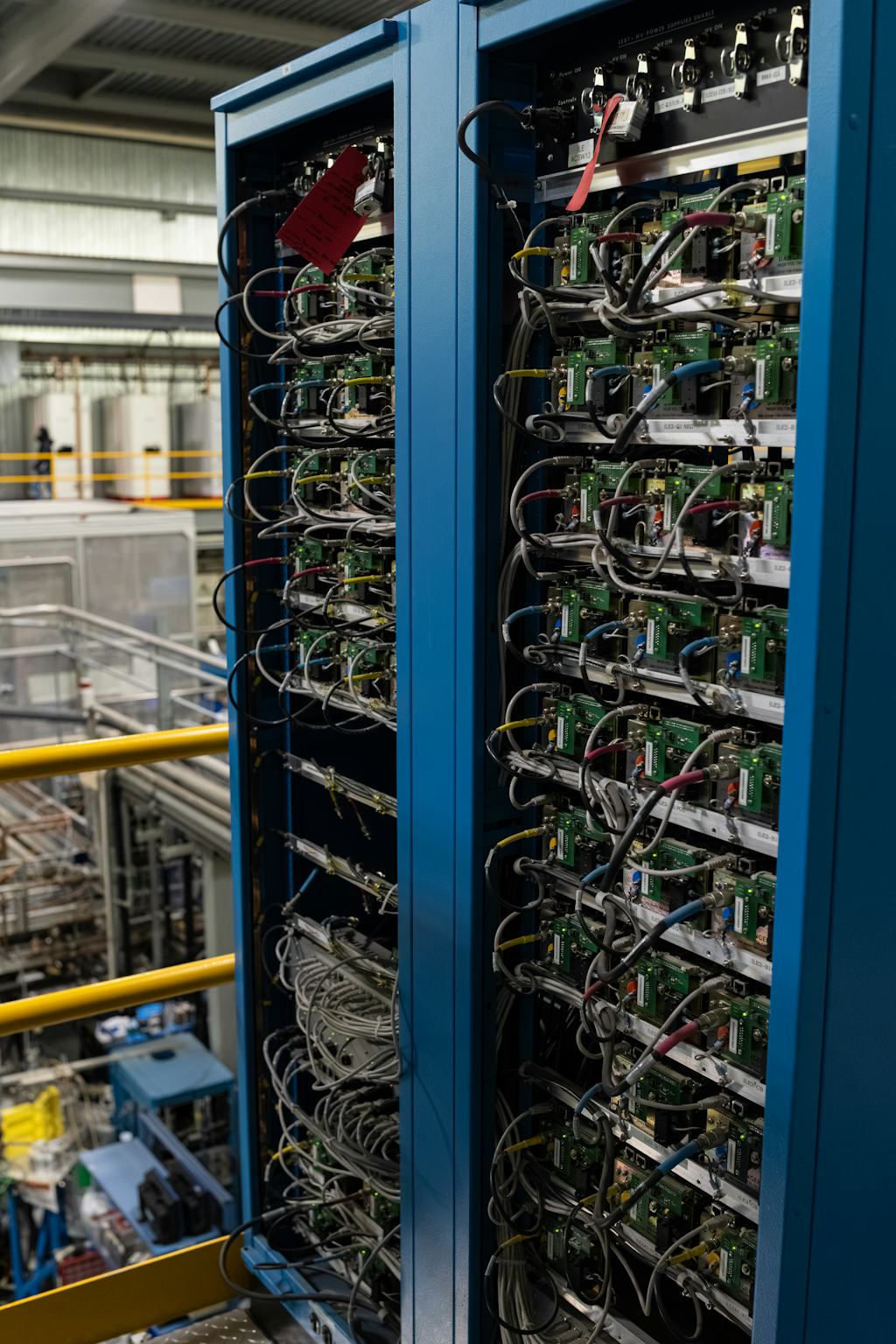

Antras atsakymas iš techninės pusės. Inference reikalauja greitos atminties (HBM tipo), kad modelis galėtų greitai pasiekti savo „svoris”. Greita atmintis dabar yra deficitinė prekė. Q1 2026 jos kainos pakilo 95 procentais. Tai vienas iš svarbiausių hyperscalerių rekordinių 660 mlrd. dolerių išlaidų faktorių.

KO TAI REIŠKIA TAU

Kai naudoji ChatGPT Free planą, OpenAI moka už tavo užklausų inference. Kai naudoji Pro planą, dalį padengi tu. Bet inference kaina nuolat auga. Dėl to:

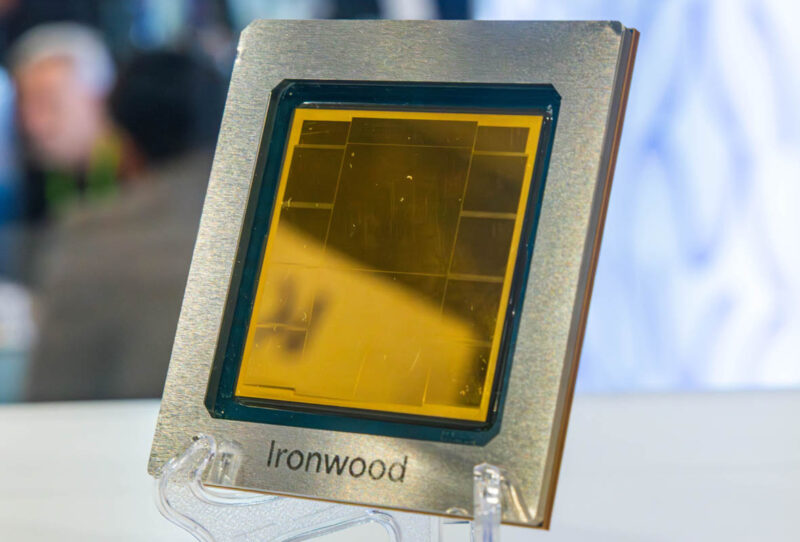

Anthropic pakėlė trečiųjų šalių prieigą 50 kartų. Claude Code 67 procentais paspartintas, kad inference vienas užklausos kaip galima greičiau pasibaigtų. Meta sukūrė savo MTIA lustus, kad sumažintų inference kainą. Anthropic veda kalbas su Fractile dėl naujos kartos inference lustų.

KO LIETUVAI

Lietuvai šitas klausimas lyg ir tolimas, bet faktas paprastas. Kai tu naudoji DI įrankį (vis tiek kurį), inference vyksta kažkur duomenų centre. Šiandien dažniausiai JAV ar Airijoje. Vilniaus „Tildė” ir kiti vietiniai DI startuoliai stengiasi savo modelius paleisti vietoje, kad inference būtų pigesnis ir greitesnis. LitAI duomenų centras ateityje galės būti viena iš vietų, kur šitas inference vyks.

SVARBIAUSIAS DALYKAS, KURĮ REIKIA ŽINOTI

Kiekvieną kartą, kai DI atsakymas užtrunka kelias sekundes vietoj kelių dešimtosios, beveik visada to priežastis yra inference apkrova kažkur kitur. Ne tavo kompiuteris, ne interneto greitis. Lustų krūva kažkokiame Las Vegas duomenų centre.

Dabar žinai, kodėl. Kitą kartą, kai Claude ar ChatGPT „mąsto” 10 sekundžių, žinai, kad kažkas duomenų centre stengiasi tau paslaugauti.

Buvai girdėjęs šio termino anksčiau? Parašyk, kokie kiti DI techniniai terminai tau atrodo migloti, parašysime jiems atskirą tekstą.