Kas yra transformer architektūra: technologija, ant kurios stovi visas dabartinis DI

·

2017 metais Google mokslininkai paskelbė straipsnį pavadinimu „Attention Is All You Need”. Aštuoni autoriai. 15 puslapių. Tas straipsnis pakeitė viską.

Transformer architektūra yra pagrindas, ant kurio stovi ChatGPT, Claude, Gemini, Llama ir praktiškai kiekvienas modernus DI modelis. Jei DI būtų pastatas, transformer būtų jo pamatas.

Kaip tai veikia paprastai

Seniau DI skaitė tekstą kaip tu skaitai knygą: nuo pradžios iki galo, žodis po žodžio. Problema ta, kad ilgame tekste jis „pamiršdavo” pradžią, kol pasiekdavo pabaigą.

Transformer daro kitaip. Jis žiūri į visus žodžius vienu metu. Ir kiekvienam žodžiui „nusprendžia”, kurie kiti žodžiai jam svarbiausi. Tai vadinama „dėmesio mechanizmu” (attention).

Pavyzdžiui, sakinyje „Katė sėdėjo ant kilimėlio ir ji miegojo” modelis turi suprasti, kad „ji” reiškia „katė”, ne „kilimėlis”. Dėmesio mechanizmas leidžia tai padaryti be specialių taisyklių. Modelis tiesiog išmoksta.

Kodėl tai buvo revoliucija

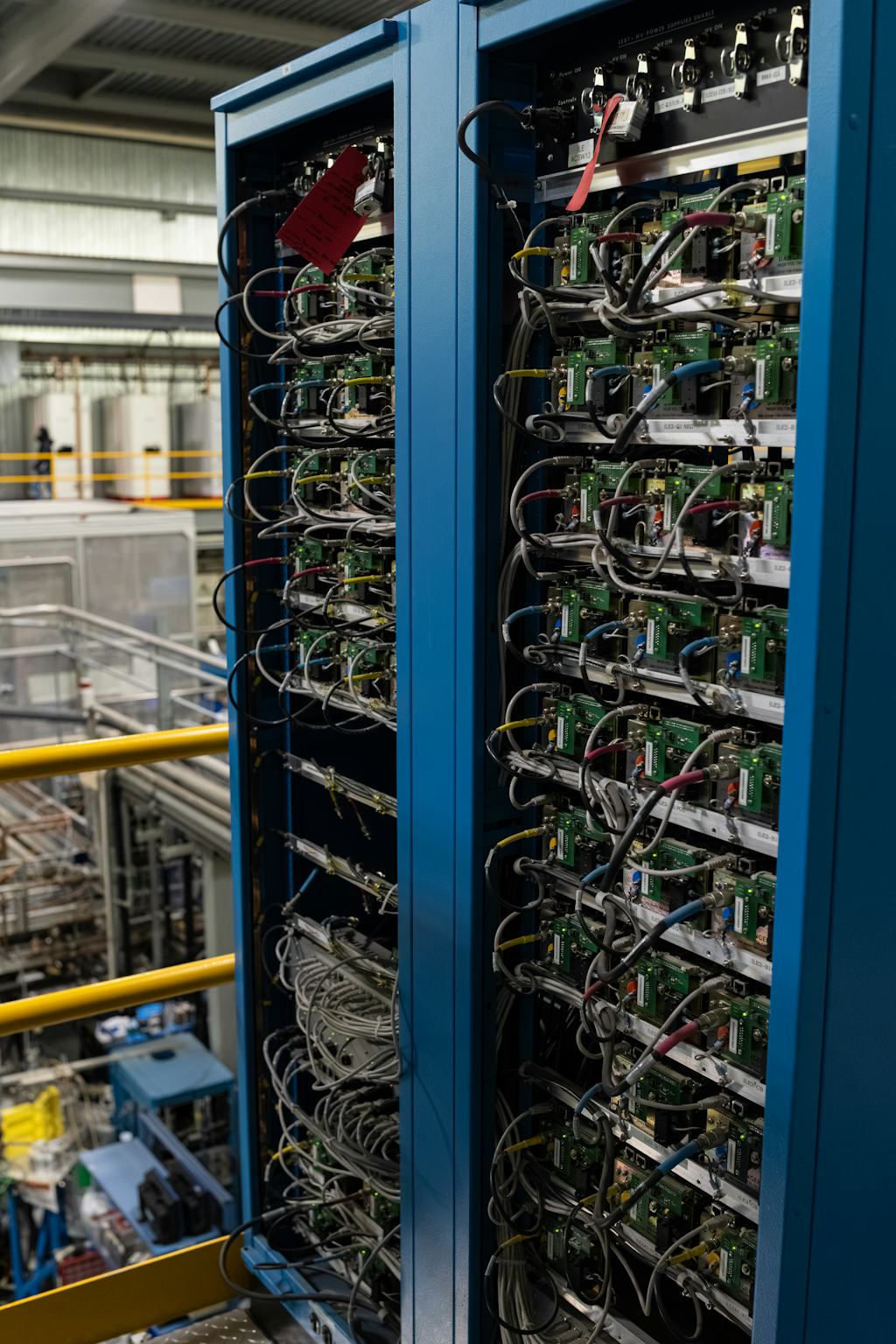

Prieš transformer, DI kalbos modeliai buvo lėti ir riboti. Jie negalėjo apdoroti ilgų tekstų, negalėjo efektyviai mokytis iš didelių duomenų kiekių. Transformer tai pakeitė, nes jo architektūra puikiai tinka paralelizavimui. Tai reiškia, kad galima mesti ant jo tūkstančius GPU ir jis greitės proporcingai.

Didieji kalbos modeliai tapo įmanomi būtent dėl transformer. Be jo, nebūtų nei ChatGPT, nei Claude, nei nieko, ką šiandien vadiname generatyviniu DI.

Kas toliau

Transformer nėra tobulas. Jis sunaudoja labai daug energijos ir atminties, ypač su ilgais tekstais. DI energijos krizė tiesiogiai susijusi su tuo, kaip transformer architektūra apdoroja informaciją.

Mokslininkai jau kuria alternatyvas: Mamba, RWKV, State Space modeliai. Bet kol kas niekas neprilygo transformer universalumui. Jis gali būti ne paskutinė DI architektūra, bet tikrai yra ta, kuri pakeitė istoriją.