Kas yra deep learning ir kuo jis skiriasi nuo mašininio mokymosi

·

Skaitai apie dirbtinį intelektą ir nuolat matai terminus: mašininis mokymasis, deep learning, neuroniniai tinklai. Atrodo panašu, bet ne tas pats. Paaiškinsiu paprastai, be akademinio žargono.

Pradėkime nuo pagrindų

Mašininis mokymasis yra DI šaka, kurioje kompiuteris mokosi iš duomenų. Tu duodi jam pavyzdžius, jis randa dėsningumus. Pavyzdžiui, parodai 10 000 nuotraukų su katėmis ir 10 000 be katių. Po kiek laiko jis pradeda atskirti, kur katė, o kur ne.

Deep learning yra mašininio mokymosi potipis. Specifinė technika, kuri naudoja neuroninius tinklus su daugybe sluoksnių. Žodis „deep” reiškia ne „gilus” filosofine prasme, o tiesiog „daug sluoksnių”.

Paprasta analogija

Įsivaizduok, kad mokaisi atpažinti paukščius.

Mašininis mokymasis: kažkas tau pasakė, kad žiūrėk į snapą, spalvą ir dydį. Tu pagal šiuos požymius mokaisi skirti vieną paukštį nuo kito. Požymius parinko žmogus.

Deep learning: niekas tau nepasakė, į ką žiūrėti. Tu tiesiog žiūri į tūkstančius nuotraukų ir pats iš lėto pradedi matyti skirtumus. Galbūt net tokius, kurių žmogus nematytų, kaip subtilūs plunksnų raštai ar galvos pasvirimo kampas.

Tai esminis skirtumas. Deep learning pats suranda, kas svarbu.

Kodėl deep learning tapo toks galingas

Trys priežastys suėjo į vieną vietą maždaug 2012-aisiais:

Pirma, atsirado pakankamai duomenų. Internetas, socialiniai tinklai, jutikliai, kameros. Duomenų vandenynas, kuriame deep learning gali plaukti.

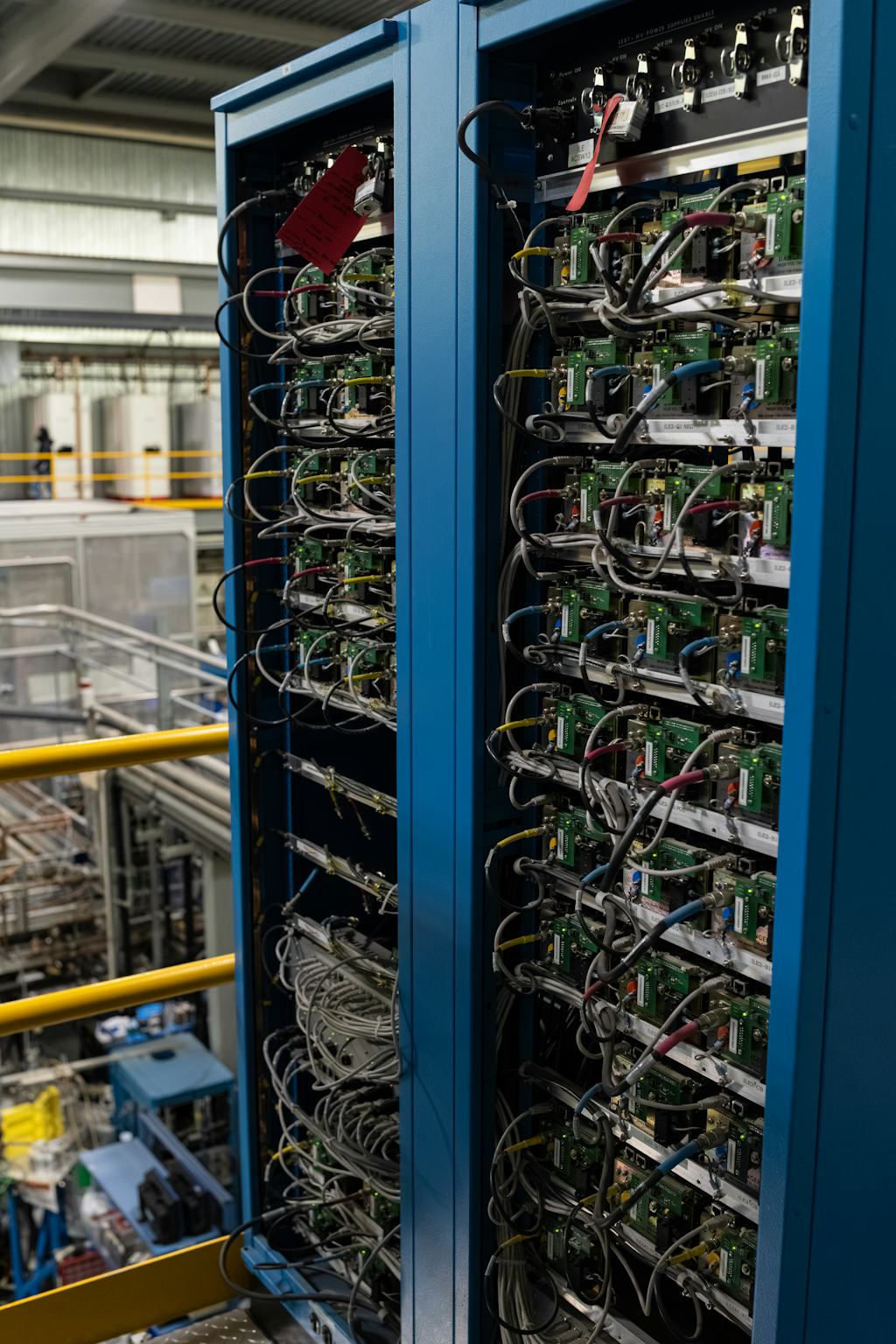

Antra, atsirado pakankamai galingų kompiuterių. Ypač GPU (grafikos procesorių), kurie puikiai tinka lygiagrečiams skaičiavimams. Tai pati priežastis, kodėl NVIDIA tapo viena brangiausių kompanijų pasaulyje.

Trečia, algoritmų proveržiai. Mokslininkai sugalvojo, kaip efektyviau treniruoti gilius neuroninius tinklus. Backpropagation, dropout, batch normalization. Neskamba seksualiai, bet veikia.

Kur deep learning naudojamas šiandien

Praktiškai visur, kur matai „DI”:

- ChatGPT, Claude, Gemini ir kiti pokalbių asistentai. Jų pagrindas yra transformer architektūra, kuri yra deep learning variantas

- Kompiuterinis matymas. Autonominiai automobiliai, veidų atpažinimas, medicininė diagnostika

- Balso atpažinimas. Siri, Alexa, Google Assistant

- Vaizdo generavimas. DALL-E, Midjourney, Stable Diffusion

- Vertimas. Google Translate nuo 2016-ųjų naudoja deep learning ir kokybė pašoko drastiškai

Deep learning trūkumai

Ne viskas rožėmis kvepia. Deep learning modeliai:

Reikalauja daug duomenų. Jei turi 50 pavyzdžių, deep learning nepadės. Paprastesni mašininio mokymosi metodai čia geriau.

Sunkiai paaiškina savo sprendimus. Kai modelis su 175 mlrd. parametrų pasako, kad nuotraukoje yra katė, tu tikrai nežinai kodėl jis taip nusprendė. Tai vadinama „juodosios dėžės” problema.

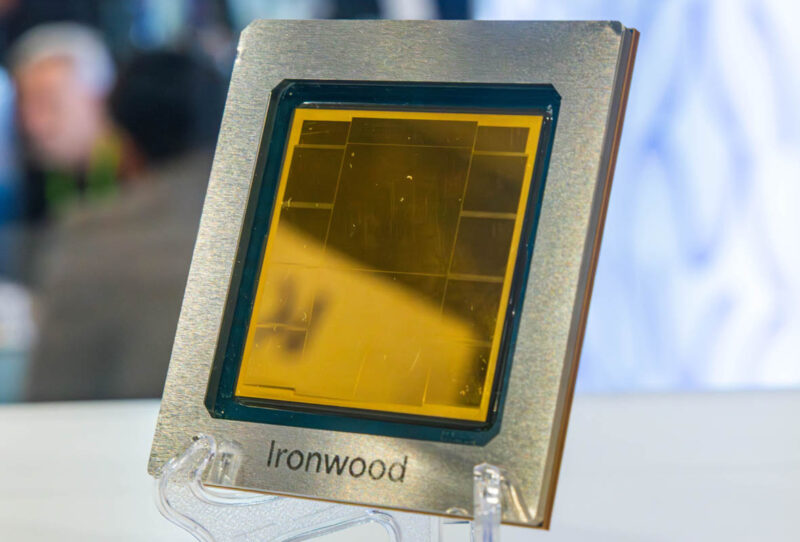

Kainuoja krūvas pinigų treniruoti. OpenAI pritraukė 122 mlrd. dolerių ne šiaip sau. Didelių modelių treniravimas reikalauja milžiniškų resursų.

Ar tau reikia suprasti deep learning

Jei esi programuotojas ar duomenų mokslininkas, tai taip, tikrai verta gilintis.

Jei esi verslininkas ar tiesiog nori efektyviau naudoti DI kasdien, tau nereikia suprasti matematikos. Užtenka žinoti principą: deep learning leidžia kompiuteriams mokytis iš pavyzdžių be to, kad žmogus jiems pasakytų, į ką žiūrėti.

Tai yra priežastis, kodėl ChatGPT gali rašyti tekstus, generuoti kodą ir atsakyti į klausimus. Ne todėl, kad kažkas suprogramavo kiekvieną atsakymą. O todėl, kad modelis perskaitė didžiąją dalį interneto ir pats išmoko kalbos struktūras.

Ir tai, mano nuomone, yra gana nuostabu. Net jei kartais tie modeliai kuria deepfake”us ir kelia problemų.

Jei nori suprasti daugiau DI terminų, peržiūrėk mūsų DI terminų žodyną.